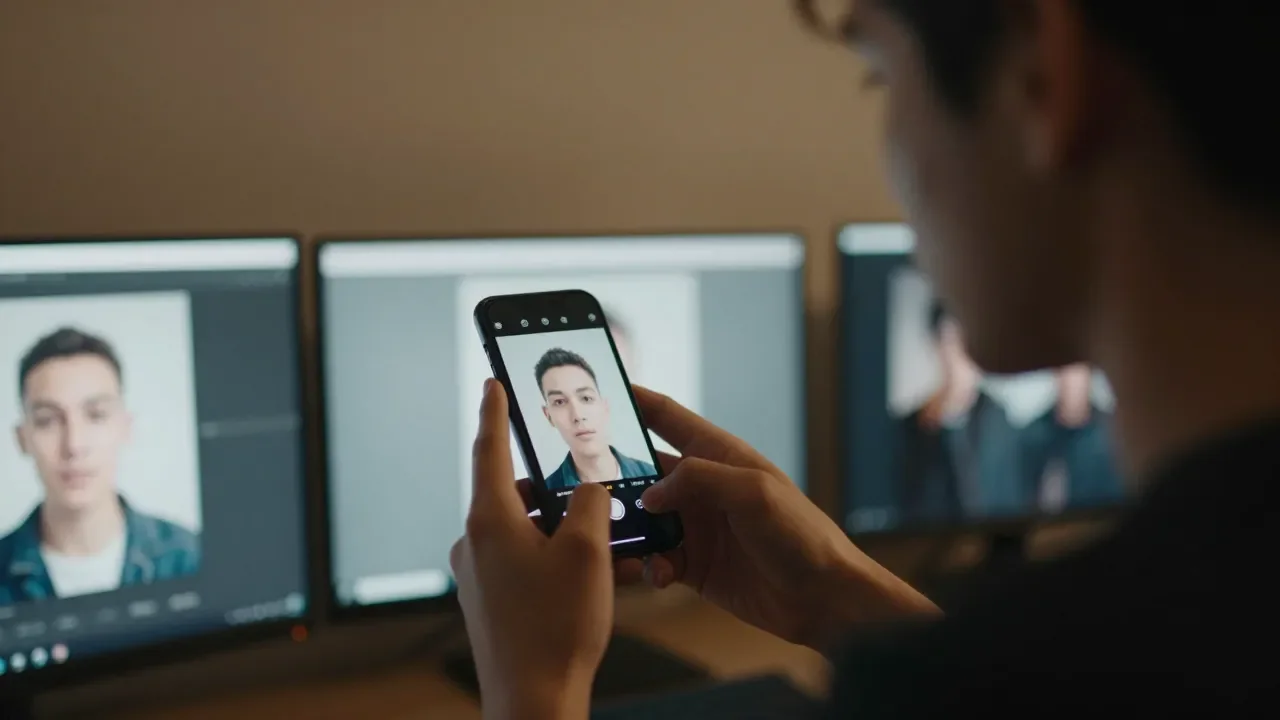

Uma declaração atribuída a uma autoridade que nunca foi dita, uma reportagem do Jornal Nacional distorcida e até o acesso indevido a contas privadas: os deepfakes se consolidaram como um dos maiores desafios à segurança digital. Com o avanço das IAs generativas, a pressão por soluções eficazes para controlar o uso malicioso dessa tecnologia só aumenta.

O que é deepfake e como identificá-lo

Deepfake é conteúdo gerado por inteligência artificial que altera vídeos ou fotos originais de forma a torná-los hiper-realistas. O principal perigo está nas intenções por trás da manipulação — muitas vezes ilícitas. No Brasil, houve um aumento de 700% em fraudes baseadas em deepfake no último ano, segundo a empresa de verificação de identidade Sumsub.

Por que os deepfakes são tão perigosos?

O advogado Mario Cosac, sócio do Failla Lima Advogados e especialista em responsabilidade civil e tecnologia, aponta que o crescimento de bases de dados e o acesso a ferramentas avançadas tornaram os deepfakes mais sofisticados, atingindo sobretudo pessoas públicas. “Personalidades públicas e influentes têm conteúdo audiovisual em abundância. Isso torna muito mais acessível criar um deepfake hoje em dia”, afirma.

Nas redes sociais, esses conteúdos se espalham rapidamente e representam riscos em várias frentes, segundo Cosac:

- Desinformação: vídeos manipulados podem influenciar decisões e prejudicar a reputação de terceiros — ele cita o impacto das fake news no plebiscito do Brexit como exemplo.

- Erosão da confiança pública: a circulação massiva de materiais questionáveis gera desconfiança sobre o que é real, afetando a base da democracia.

- Aumento de crimes digitais: além de violações de direitos de imagem, golpes e falsificações de identidade atingem desde pessoas físicas (como contatos falsos no WhatsApp) até grandes empresas — Cosac lembra o caso de 2024 em que um funcionário da britânica Arup pagou US$ 25 milhões a criminosos após uma videochamada com um “diretor financeiro” feito por deepfake.

Riscos empresariais e o papel das IAs avançadas

Do ponto de vista corporativo, Augusto Salomon, CEO da StarMind e especialista em IA, ressalta que o problema muitas vezes está na falta de preparo das empresas ao adotar a tecnologia. “Nessa corrida, as empresas acabam comprando ferramentas que não são adequadas para o negócio e acabam caindo em problemas de segurança”, explica.

Tanto Cosac quanto Salomon deixam claro que o uso de modelos avançados de IA, como o Veo 3, não é em si o problema — esses recursos têm aplicações legítimas, por exemplo na indústria cinematográfica e do entretenimento. O cerne da questão é o uso indevido dessas ferramentas.

Como proteger a sociedade do uso nocivo da IA?

No Brasil não existe legislação específica para deepfakes. Há projetos em tramitação no Congresso que tratam da regulamentação da IA, mas os especialistas defendem que a lei sozinha não resolve. Entre as outras abordagens em discussão estão iniciativas internacionais, como um projeto na Dinamarca que propõe dar aos cidadãos controle sobre os direitos autorais de seu rosto e voz.

Plataformas também trabalham no aprimoramento de sistemas de detecção e verificação de conteúdo gerado por IA. Para Cosac e Salomon, porém, é fundamental avançar em educação digital: navegar na internet e usar IA exige pensamento crítico e checagem constante. “Tem que ter um processo de aculturamento das pessoas em relação à IA, independentemente da idade, porque nós estamos vivendo uma nova era comparável à Revolução Industrial”, afirma Augusto Salomon.

A combinação entre regulação, tecnologia de detecção, controle de direitos individuais e educação digital aparece como o caminho mais sólido para mitigar os riscos dos deepfakes — enquanto a sociedade aprende a conviver com uma tecnologia capaz de criar imagens e sons quase indistinguíveis da realidade.