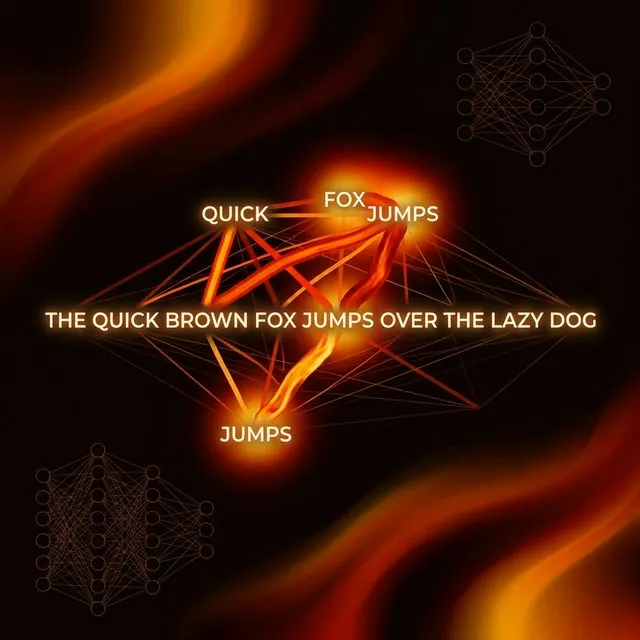

Explainable AI (XAI)

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

Técnicas para tornar decisões de modelos de IA compreensíveis e interpretáveis por humanos.

Definição Detalhada

XAI aborda o problema da 'caixa-preta' dos modelos complexos, onde decisões são opacas. Métodos incluem: LIME (explicações locais), SHAP (valores de Shapley para contribuição de features), Grad-CAM (visualização de atenção em imagens), attention visualization e modelos intrinsecamente interpretáveis (árvores de decisão, regressão linear). Essencial para compliance regulatório (AI Act, LGPD) e confiança em aplicações críticas.

Exemplos Práticos

Explicar por que um empréstimo foi negado, mostrar quais regiões de uma radiografia indicam doença, justificar decisões de veículos autônomos.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56