Rede Neural Artificial

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

Sistema computacional inspirado no cérebro, composto por camadas de neurônios artificiais interconectados que aprendem padrões a partir de dados.

Definição Detalhada

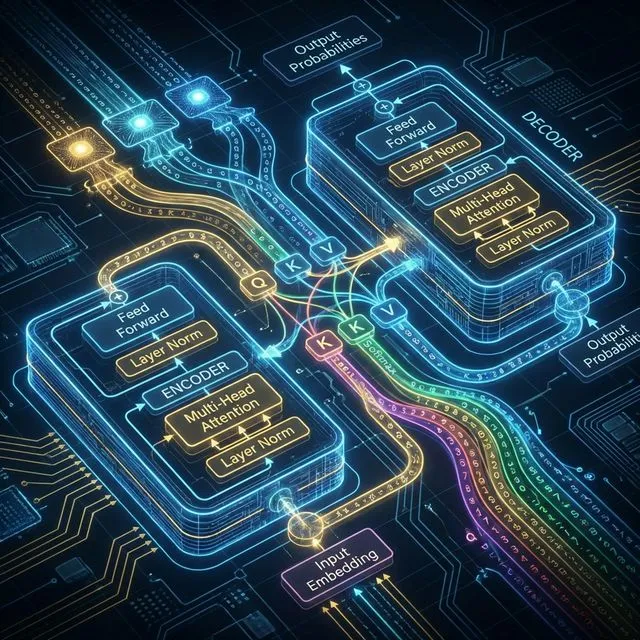

Redes neurais são compostas por neurônios organizados em camadas: entrada, ocultas e saída. Cada conexão tem um peso ajustado durante o treinamento via backpropagation e gradient descent. Funções de ativação (ReLU, Sigmoid, Tanh) introduzem não-linearidade. Arquiteturas incluem feedforward, convolucional (CNN), recorrente (RNN), Transformer e graph neural networks. O deep learning usa redes com muitas camadas ocultas.

Exemplos Práticos

Reconhecimento facial, previsão de preços de ações, diagnóstico médico, tradução automática, reconhecimento de voz.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56