Alucinação de IA

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

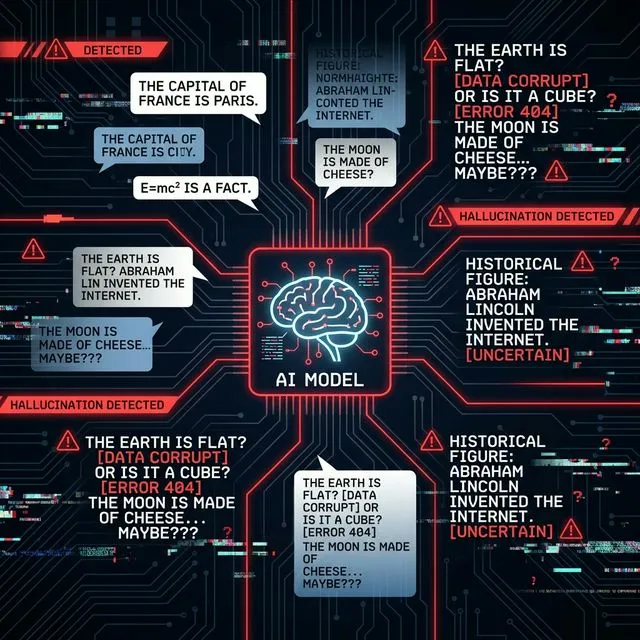

Definição Básica

Fenômeno em que modelos de IA geram informações que parecem convincentes mas são factualmente incorretas ou completamente inventadas.

Definição Detalhada

Alucinações ocorrem porque LLMs geram texto baseado em padrões estatísticos, não em compreensão factual. Tipos incluem: alucinação factual (dados incorretos), alucinação de atribuição (citações inventadas), inconsistência lógica e fabricação completa. Mitigações incluem RAG, grounding em bases de dados, calibração de temperatura, e técnicas de self-reflection como Chain-of-Verification.

Exemplos Práticos

LLMs inventando referências acadêmicas, gerando biografias com fatos falsos, criando código que referencia funções inexistentes.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56