Mecanismo de Atenção (Attention)

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

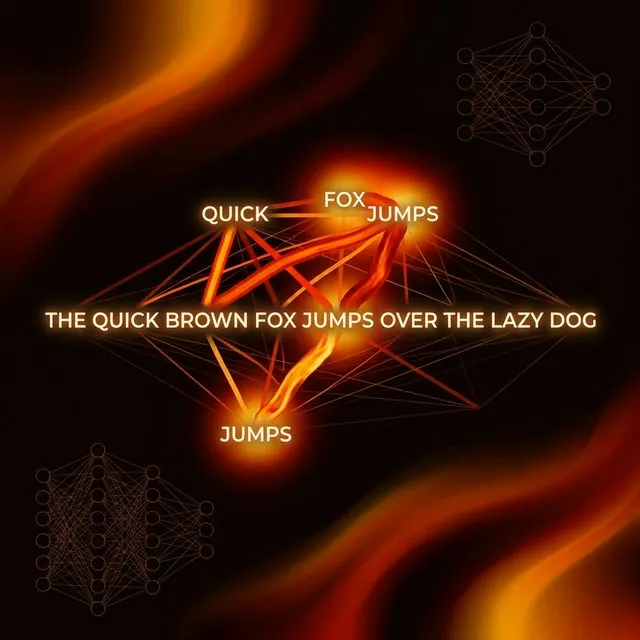

Definição Básica

Mecanismo que permite que modelos de IA foquem nas partes mais relevantes dos dados de entrada ao processar informação.

Definição Detalhada

O mecanismo de atenção calcula pesos de importância para cada elemento da entrada usando queries, keys e values. Self-attention permite que cada posição de uma sequência atenda a todas as outras posições. Multi-head attention executa múltiplas operações de atenção em paralelo, capturando diferentes tipos de relações. Flash Attention é uma otimização que reduz o uso de memória e acelera o cálculo.

Exemplos Práticos

Em tradução, a atenção conecta 'gato' a 'cat'; em visão, foca em regiões relevantes de uma imagem para classificação.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56