Embeddings

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

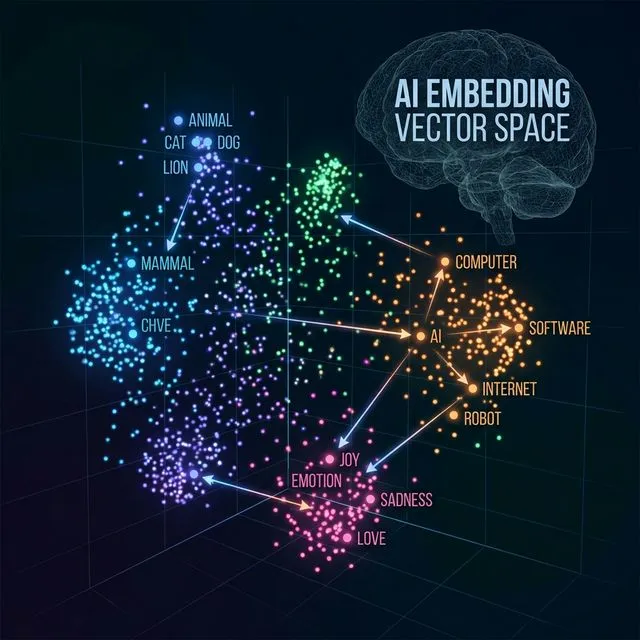

Representações numéricas vetoriais de dados (texto, imagens, áudio) que capturam significado semântico em espaço multidimensional.

Definição Detalhada

Embeddings transformam dados complexos em vetores densos de números reais, onde itens semanticamente similares ficam próximos no espaço vetorial. Word embeddings (Word2Vec, GloVe) representam palavras; sentence embeddings representam frases inteiras. Modelos modernos como OpenAI Ada, Sentence-BERT e Cohere geram embeddings de alta qualidade usados em busca semântica, clustering e RAG.

Exemplos Práticos

Busca semântica ('como cozinhar arroz' encontra 'receita de arroz branco'), sistemas de recomendação, detecção de plágio, clustering de documentos similares.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56