RAG (Retrieval-Augmented Generation)

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

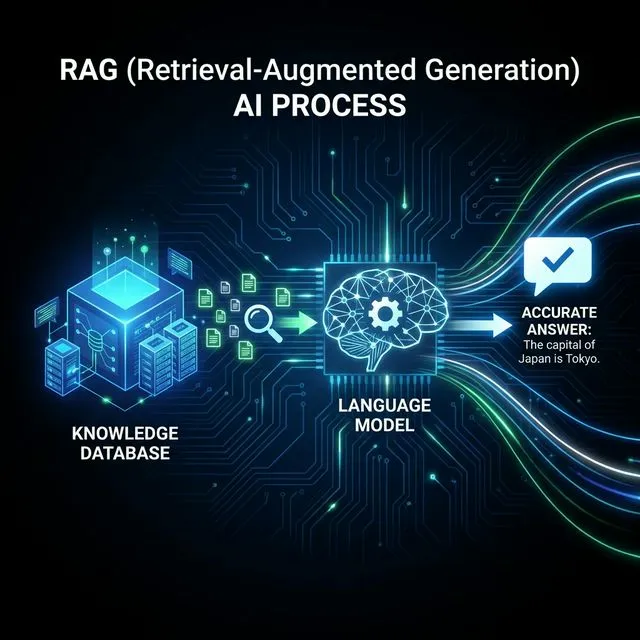

Técnica que combina busca em bases de conhecimento com geração de texto por LLMs para respostas mais precisas e atualizadas.

Definição Detalhada

RAG resolve o problema de alucinação e desatualização dos LLMs ao buscar informações relevantes em bases de dados externas antes de gerar respostas. O processo envolve: (1) converter documentos em embeddings vetoriais, (2) armazenar em banco de dados vetorial, (3) buscar trechos relevantes ao receber uma pergunta, (4) fornecer esses trechos como contexto ao LLM. Isso permite que o modelo acesse informações proprietárias e atualizadas sem retreinamento.

Exemplos Práticos

Chatbots corporativos que consultam documentação interna, assistentes jurídicos que citam legislação atualizada, suporte técnico baseado em manuais.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56