LoRA (Low-Rank Adaptation)

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

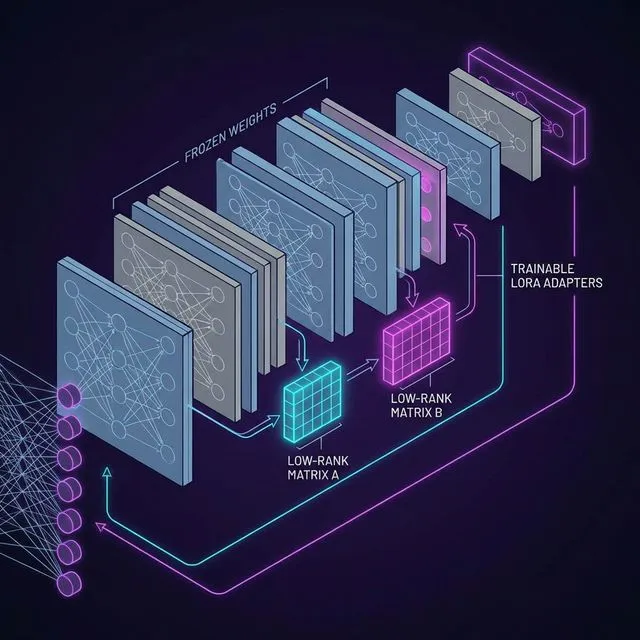

Técnica eficiente de fine-tuning que ajusta apenas uma pequena fração dos parâmetros de um modelo, reduzindo drasticamente custos computacionais.

Definição Detalhada

LoRA funciona congelando os pesos originais do modelo e inserindo matrizes de baixo rank treináveis nas camadas de atenção. Isso reduz o número de parâmetros treináveis em até 10.000x, permitindo fine-tuning em GPUs consumer. QLoRA combina LoRA com quantização de 4-bit para reduzir ainda mais os requisitos de memória.

Exemplos Práticos

Fine-tuning de Stable Diffusion para gerar imagens em estilos específicos, personalização de LLMs em laptops com 8GB de VRAM.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56