BERT

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

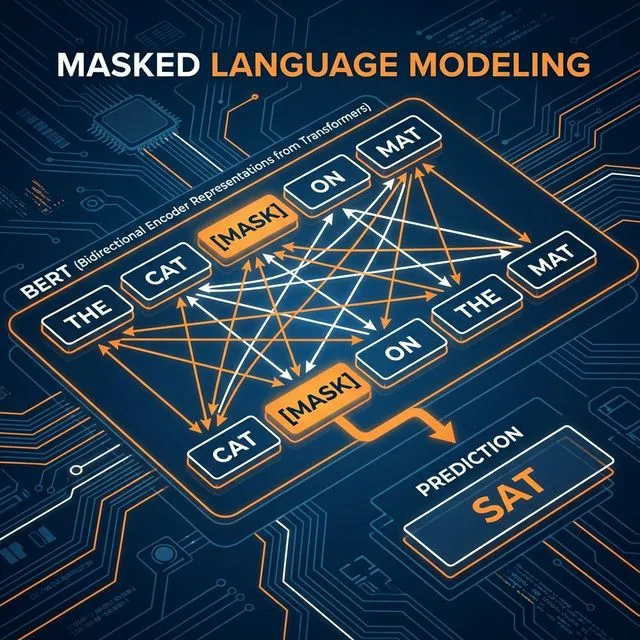

Bidirectional Encoder Representations from Transformers — modelo de linguagem bidirecional da Google para compreensão de texto.

Definição Detalhada

BERT revolucionou o NLP ao introduzir o pré-treinamento bidirecional, onde o modelo aprende o contexto de uma palavra olhando tanto para a esquerda quanto para a direita simultaneamente. Treinado com tarefas de Masked Language Modeling (MLM) e Next Sentence Prediction (NSP), BERT excele em tarefas de compreensão como classificação de texto, extração de entidades e resposta a perguntas.

Exemplos Práticos

Motor de busca do Google, classificação de sentimentos em reviews, extração de informações de documentos jurídicos.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56