Transformer

Atualizado em: 22/02/2026 08:56Imagens Ilustrativas

Definição Básica

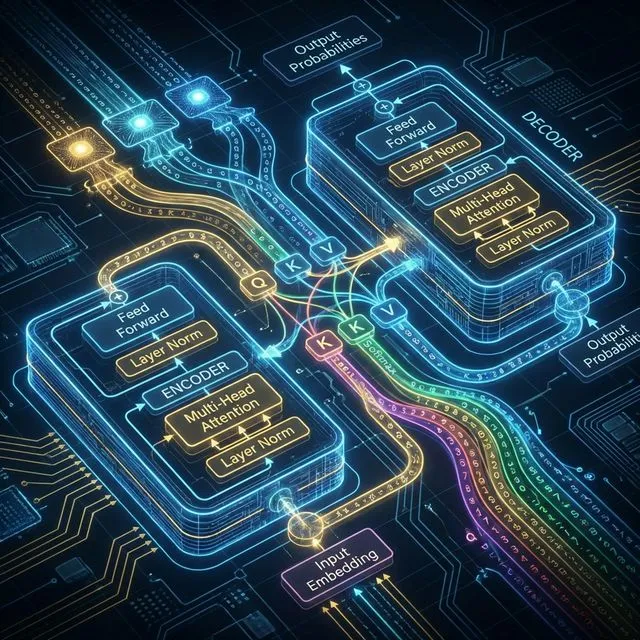

Arquitetura de rede neural baseada em mecanismos de atenção, revolucionária para processamento de sequências.

Definição Detalhada

Introduzida no artigo 'Attention Is All You Need' (2017) pela Google, a arquitetura Transformer substituiu as RNNs ao processar sequências inteiras em paralelo usando mecanismos de self-attention. Composta por encoder e decoder com camadas de atenção multi-cabeça, permite capturar dependências de longo alcance em dados sequenciais. É a base de praticamente todos os modelos modernos de IA, incluindo BERT, GPT, T5, ViT e modelos de difusão.

Exemplos Práticos

BERT para busca do Google, GPT-4 para ChatGPT, Vision Transformer (ViT) para classificação de imagens, Whisper para transcrição de áudio.

Termos Relacionados

Criado em: 22/02/2026 08:56

| Última atualização: 22/02/2026 08:56